詳解相機的sensor工作原理

詳解相機的sensor工作原理_sensor原理_Spark!的博客-CSDN博客

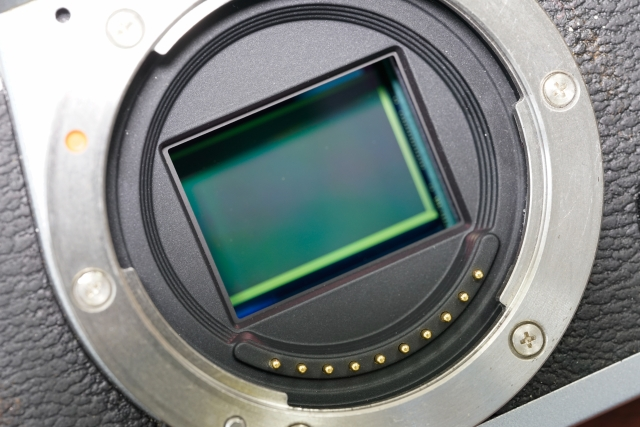

相機或攝像頭使用數百萬個微小的光腔(感光元件)來記錄圖像。

- 成像時,sensor將鏡頭投射來的光子儲存為模擬電信號。

- 曝光完成後,相機關閉這些光腔(感光元件),然後通過測量模擬電信號的強度來評估每個腔中有多少光子掉入來計算數字電信號的數值。

- 然後模擬電信號轉換為數字電信號,數字電信號的數值由位深度決定(RGB的位深度)。

- 最後,根據正在記錄的文件格式(8位JPEG位0-255),可能會再次降低生成精度

腔陣列

光腔

但是,上述插圖只會創建灰度圖像,因為這些腔無法區分它們每種顏色的多少。

要捕捉彩色圖像,必須放置一個過濾器在每個腔上,只允許特定顏色的光。幾乎所有當前數碼相機都只能捕獲每個腔中的三種主要顏色之一,因此它們丟棄了大約 2/3 的傳入光。

因此,相機必須接近其他兩種原色,才能在每像素上全彩。最常見的顏色濾鏡陣列稱為”拜耳陣列”,如下所示。

顏色濾鏡陣列

帶顏色濾光片的光腔

拜耳陣列由紅綠藍三色濾波器交替排列組成。

請註意拜耳陣列中包含的綠色傳感器是紅色或藍色傳感器的兩倍。由於人眼對綠光比紅光和藍光更敏感,因此每種原色不會獲得總面積的同等比例。

綠色像素的冗余會生成一個圖像,該圖像看起來不那麽嘈雜,並且具有比每種顏色均等處理時所能完成的更精細的細節。這也解釋了為什麽綠色通道中的噪音比其他兩種主要顏色要小得多(常見圖像噪聲及產生原因(高斯、泊松和椒鹽噪聲))。

原始場景

相機看到的場景(拜爾整列)

放大後如下圖

註意:並非所有數碼相機都使用拜耳陣列,但這是迄今為止最常見的設置。

例如,Foveon 傳感器在每個像素位置捕獲所有三種顏色,而其他傳感器可能會在類似的陣列中捕獲四種顏色:紅色、綠色、藍色和祖母綠。

拜爾馬賽克變換(BAYER DEMOSAICING)

拜耳的”馬賽克變換(DEMOSAICING)”是將拜耳的原色陣列轉換為包含每個像素全彩色信息的最終圖像的過程。

如果相機無法直接測量全彩,這怎麽可能?理解這一點的一種方法是將每 2×2 陣列的紅色、綠色和藍色視為一個單一的全彩腔。

→

這就是rgb色彩空間,一個像素是rggb排列的原因

sensor中四個像素點對應rgb一個像素點

如果攝像機將每個 2×2 陣列中的所有顏色視為落在同一位置,則只能在水平方向和垂直方向上實現一半的分辨率。

另一方面,如果相機使用幾個重疊的 2×2 陣列計算顏色,則其分辨率可能高於單組 2×2 陣列。以下重疊的 2×2 陣列組合可用於提取更多圖像信息。

這樣裁出來只有9個像素點,比sensor光腔數量實際的要少7個。原因可能和sensor設計相關,sensor的光腔數量和實際像素不對應,實際光腔數量要大得多,出來的圖像是裁剪過的。

這也和sensor的安裝有關,sensor不可能嚴絲合縫,一定存在誤差,於是足夠大的sensor就可以避免由於安裝的偏移導致的圖像顯示不完全的問題

有可能你要說,56789的排列不是rggb了。解釋為微積分中的近似模擬,即盡可能接近的去模擬。也和sensor廠商的設計有關如上圖,海思方案給出了sensor取像起始點的設置,這也說明sensor的面積大於像素面積。

請註意,我們如何沒有計算陣列邊緣的圖像信息,因為我們假設圖像繼續向各個方向移動。如果這些實際上是腔陣列的邊緣,那麽這裏的計算將不太準確,因為四面不再有像素。不過,這通常可以忽略不計,因為圖像邊緣的信息很容易被裁剪出來,在具有數百萬像素的攝像機比較常用。

存在其他馬賽克變換(DEMOSAICING)算法,可以提取略多的分辨率,生成噪音較小的圖像,或適應每個位置的圖像的最佳近似值。

拜爾陣列的排列

海思方案中提供了sensor的pub屬性設置,這四種都是拜爾整列的排列

不同的sensor排列方式不同,需要查看用戶使用sensor的數據Sohu測

維倫陣列

您可能想知道為什麽本文中的第一個圖表沒有將每個腔直接放在彼此旁邊。真實世界的相機實際上沒有將感光單元(photosites)覆蓋整個sensor表面。事實上,為了適應其他電子器件,它們可能只覆蓋了總面積的一半。

每個光腔之間都顯示有小山峰,將光子引向一個或另一個腔。數碼相機在每個攝影點上方都裝有”微透鏡”,以提高其采光能力。這些鏡頭類似於漏鬥,漏鬥將光子引導到光腔,否則光子將未使用

精心設計的微透鏡可以改善每個光場的光子信號,然後創建相同曝光時間噪音較小的圖像。相機制造商已經能夠使用微透鏡設計的改進,以減少或維護噪音的最新高分辨率相機,盡管有較小的感光單元,還是可以擠壓更多的百萬像素到同一傳感器區域。

光電轉換

sensor采集環境光轉換為模擬電信號的過程,光信號轉為模擬電信號

模數轉換

也稱ADC、AD轉換

光電轉換後,模擬電信號轉為數字電信號的過程,RGB_BYRE產生

這時RGB_BYRE的位深度根據sensor的ADC轉換器決定,如上兩張圖都是10bit

ISP

一般sensor中會內置ISP功能,但是開發不用它,通常使用芯片廠商提供的ISP功能

一般來說,sensor中都會簡單的做好一些ISP調優,能出來稍微能看的圖像,要調的更好,就需要使用芯片廠商提供的ISP方案

不過使用sensor中的ISP可以降低主SOC的消耗,如果考慮開銷的話,ISP可以放在sensor或者外接ISP芯片去做

image output

ISP處理完生成YUV數據流,而後通過接口發送給CPU

這個接口有很多,如DVP、LVDS、MIPI,常用MIPI

還有傳輸控制信號的接口,常用I2C

市面上有很多sensor廠家,sensor型號眾多,在選擇sensor的時候不可避免要反覆重新編譯、加載驅動,非常麻煩。

海思提出了應用層驅動的概念來更方便的對接sensor。

就是將每個sensor不同的配置封裝成庫,將要配置的寄存器和值通過控制信號接口(I2C)與硬件交互。

以庫的方式提供,能達到解耦合的效果,更換sensor非常方便。

海思的ISP也是使用的這個結構

接近數字傳感器分辨率極限的小規模細節圖像有時會欺騙馬賽克變換算法,產生不切實際的結果。最常見的人為可觀的現象是 moiré(發音為”more”),它可能顯示為重覆圖案、彩色人為可觀的現象或像素排列在不切實際的迷宮般的圖案中:

上面顯示了兩張單獨的照片,每張照片的放大倍數都不一樣。請註意,除了第一張照片的第三個正方形(細微差別)外,所有四個底部正方形中都出現了 moiré 。迷宮般的和彩色的紋理都可以在縮小版本的第三個正方形看到。這些紋理取決於用於開發數碼相機RAW文件的紋理類型和軟件。

然而,即使有一個理論上完美的sensor,可以捕捉和區分所有顏色在每個照片現場,moiré和其他紋理或現象仍然可能出現。這是任何系統不可避免的後果,該系統以離散的時間間隔或位置對其他連續信號進行采樣。因此,幾乎每個攝影數字傳感器都集成了所謂的光學低通濾鏡 (OLPF) 或防別名 (AA) 濾鏡。這通常是傳感器正前的薄層,通過有效地模糊任何可能的問題細節,比傳感器的分辨率更精細。

版權聲明:本文為CSDN博主「Spark!」的原創文章,遵循CC 4.0 BY-SA版權協議,轉載請附上原文出處鏈接及本聲明。

原文鏈接:https://blog.csdn.net/qq_28258885/article/details/118558457

知其然知其所以然 數碼相機工作原理解讀

2014年11月05日 08:41 佳友在線 我有話說(9人參與) 收藏本文

在過去二十年裏,消費電子產品的大多數重要技術突破實際上可歸結於一項更大意義上的科技革命。仔細觀察就會發現,CD、DVD、高清電視、MP3和DVR其實都是基於相同的原理,即:將傳統的模擬信息轉變為數字信息。這一技術上的根本轉變完全顛覆了我們處理圖像和聲音信息的方式,使 許多事情成為可能。

數碼相機的出現是這一轉變最顯著的例子——它與傳統相機存在本質上的差異。數碼相機的面世,使非專業攝影師也能拍出美麗的照片成為了一件輕而易舉的事。用數碼相機拍出來的照片也有著艷麗的色彩,清晰的畫面,而且照片的後期處理更加方便和快捷。但數碼相機是怎麽工作的,以及這些工作原理和傳統的膠片相機有何異同,了解的人就不是很多了。今天我們就按照片的形成過程,從鏡頭到感光元件再到處理器和存儲系統,一步一步地來了解數碼相機的工作原理。

特別提示:本文中所有圖片均來源於網絡。

數碼相機的歷史可以追溯到上個世紀四五十年代,電視就是在那個時候出現的。伴隨著電視的推廣,人們需要一種能夠將正在轉播的電視節目記錄下來的設備。 1951年賓·克羅司比實驗室發明了錄像機,這種新機器可以將電視轉播中的電流脈沖記錄到磁帶上。到了1956年,錄像機開始大量生產。同時,它被視為電 子成像技術的誕生。

第二個裏程碑式的事件發生在二十世紀六十年代的美國宇航局。在宇航員被派往月球之前,宇航局必須 對月球表面進行勘測。然而工程師們發現,由探測器傳送回來的模擬信號被夾雜在宇宙裏其它的射線之中,顯得十分微弱,地面上的接收器無法將信號轉變成清晰的 圖像。於是工程師們不得不另想辦法。1970年是影像處理行業具有裏程碑意義的一年,美國貝爾實驗室發明了CCD。當工程師使用電腦將CCD得到的圖像信 息進行數字處理後,所有的幹擾信息都被剔除了。後來“阿波羅”登月飛船上就安裝有使用CCD的裝置,這就是數碼相機的原形。得益於這一技術,在“阿波羅” 號登上月球的過程中,美國宇航局接收到的數字圖像如水晶般清晰。

“阿波羅”號回傳的數字圖像

在這之後,數碼圖像技術發展得更快,主要歸功於冷戰期間的科技競爭。而這些技術也主要應用於軍事領域,大多數的間諜衛星都使用了數碼圖像科技技術。

在數碼相機發展史上,不得不提的是索尼公司。索尼於1981年8月在一款電視攝像機中首次采用CCD,將其用作直接將光轉化為數字信號的傳感器。目前索尼每年生產的感光元件也占據了全球很大一部分的市場,這也正是現今索尼能夠在感光元件市場上傲視群雄的一個原因,因為核心命脈掌握在自己手中。

在 冷戰結束之後,軍備科技競賽很快地轉變為了市場科技爭霸。1995年,以生產傳統相機和擁有強大膠片生產能力的柯達公司向市場發布了其研制成熟的民用消費 型數碼相機DC40。這被很多人視為數碼相機市場成型的開端。DC40使用了內置為4MB的內存,不能使用其它移動存儲介質,其38萬像素的CCD支持生 成756×504的圖像,兼容Windows 3.1和DOS。蘋果公司的QuickTake 100也同時在市場上推出。當時兩款相機都提供了對電腦的串口連接。

柯達DC40

從此之後,數碼相機就如雨後春筍般不斷由各相機廠商推出,感光元件的像素不斷增加,創意功能不斷翻新,拍攝的圖像效果也越來越接近於傳統相機了。回顧完了發展歷史,讓我們正式開始進入數碼相機的內部世界來一探究竟。

你是我的眼——鏡頭篇

人類用眼睛來感知色彩繽紛的世界,而照相機則是用鏡頭來攝取美麗的景物。人眼中客觀存在的場景實際上是一種光學信息的表達,景物反射出不同亮度和光譜的光線 以顯示出不同的色彩。照相機就是要把某一瞬間的光線永久保存下來,傳統照相機是把這些光線轉化對應為膠片上化學藥劑的變化,而這些膠片也只是半成品,還需 進一步的化學反應才能顯影,可見傳統膠片照相機的拍攝過程完全是光信號與化學信號的轉換過程。而數碼相機不管其最終的存儲介質是什麽,其本質是把一組一定 亮度和光譜的光線轉化為一堆二進制數,然後保存在某種記錄介質上,屬於光信號與電信號的轉換。然而不論是數碼相機還是傳統照相機,首先接收的都是景物的光 學信息,所以,光學鏡頭是必不可少的第一組件,被攝景物必須經過光學鏡頭才能成像到達成像器件。因此,人們常說鏡頭是相機的眼睛。

鏡頭的作用是將光線聚集到感光元件上來。相比傳統膠片相機來說,大部分數碼相機的感光元件尺寸較小,而且外部的光線有時無法產生足夠的強度來使感光器件獲得 足夠的光源信息。鏡頭就將外部的目標物體反射回來的光線通過其特定的形狀,匯聚折射到感光器件上。類似的工作狀態有點像我們小時候在自然課上學過的用一片 凸透鏡聚光來產生更多的光亮。

在通過鏡頭確認要拍攝的對象以後,我們把相機的鏡頭對準目標物體。這時,物鏡或物鏡組就會根據自動對焦系統的控制信號來調節它和感光器件的距離,使物體的像剛好落到感光元件上,這樣才可以形成清晰的圖像。而鏡頭的自動對焦系統的工作原理,就是我們要討論的重點之一。

現今的數碼相機自動對焦鏡頭從工作原理上說大多都采用了間接實測物距方式進行對焦。它是利用一些可以被利用的間接距離測量方式來獲取物距,通過運算,伺服電 路驅動調節焦距的微型馬達,帶動調焦鏡片組進行軸向移動,來達到自動調節焦距的目的。經常被利用來進行間接距離測量的方式有:無源光學基線測距、有源超聲 波測距、有源主動紅外測距以及現代的激光技術在測量領域的應用等。

無源光學基線測距:熟悉攝影的朋友都知道,這是一種在取景器裏使用光學基線原理得到磨砂、裂像、菱錐等手段的焦距調節方式。磨砂顆粒最細膩時、景物目標在兩 半圓裂像環中完全吻合上、菱錐的晶體不再明顯時就是被攝目標的物距調節到清晰了……這些應用技術都是可以通過光路傳遞給光電電路捕獲到陰影面積發生的變 化,經過一系列的函數分析計算後,進行調焦驅動。

有源超聲波測距:通過發射具有特征頻率的超聲波對被攝目標的探測,使用發射出特征頻率的超聲波和反射回接受到特征頻率的超聲波所用的時間,換算出距離,也就是物距,利用伺服電路驅動調節焦距的微型馬達,達到自動調焦的目的。

有源主動紅外測距以及現代激光技術測距:二者在原理上基本相似。這類方式在應用上目標精度極高,由此而來的高成本也是可想而知的。且體積一般都比較大,維護也相當困難,不過在高檔攝影器材中已經有了一些使用這類技術簡化版的產品出現。

對焦過程結束後,各位攝影師就該準備按下快門永久保存下令人感動的瞬間了。那麽具體的物象是如何變成一系列的光電信號的呢?讓我們接著說說感光元件那些事。

天地在我心——感光元件篇

相比傳統的膠片相機來說,數碼相機最大的改變就是將感光元件從膠片轉 變為了CCD/CMOS。傳統膠片相機使用銀鹽作為感光材料,即膠卷作為感光元件,拍攝後還需經過沖洗才能得到最終成片。不但無法第一時間得知最終效果而 且在保存上也不太方便。而數碼相機的“膠卷”就是其成像感光元件,它與相機融為一體,是數碼相機的心臟。感光元件是數碼相機的核心,也是最關鍵的技術。數 碼相機的發展道路,可以說就是感光元件的發展道路。目前數碼相機的核心成像部件有兩種:一種是的CCD,一種是CMOS。

CCD的全稱是Charge Couple Device,翻譯過來就是“光電荷耦合器件”,CMOS的全稱是Complementary Metal-Oxide Semiconductor,有“互補金屬氧化半導體”的意思。CCD和CMOS的工作原理有一個共通點,那就是都是用光敏二極管來作為光-電信號的轉化 元件。

它們每個感光元件的像素點分別對應圖像傳感器中的一個像點,由於感光元件只能感應光的強度,無法捕獲色彩信息,因 此彩色CCD/CMOS圖像傳感器必須在感光元件上方覆蓋彩色濾光片。在這方面,不同的傳感器廠商有不同的解決方案,最常用的做法是覆蓋RGB紅綠藍三色 濾光片,以1:2:1的構成由四個像點構成一個彩色像素(即紅藍濾光片分別覆蓋一個像點,剩下的兩個像點都覆蓋綠色濾光片),采取這種比例的原因是人眼對 綠色較為敏感,由此組成新的R、G、B、E四色方案,而這種解決方案就是大名鼎鼎的拜耳濾鏡。

拜耳濾鏡示意圖

在接受光照之後,感光元件產生對應的電流,電流大小與光強對應,因此感光元件直接輸出的電信號是模擬的。在CCD傳感器中,每一個感光元件都不對此作進一步 的處理,而是將它直接輸出到下一個感光元件的存儲單元,結合該元件生成的模擬信號後再輸出給第三個感光元件,依次類推,直到結合最後一個感光元件的信號才 能形成統一的輸出。由於感光元件生成的電信號實在太微弱了,無法直接進行模數轉換工作,因此這些輸出數據必須做統一的放大處理。這項任務是由CCD傳感器 中的放大器專門負責,經放大器處理之後,每個像點的電信號強度都獲得同樣幅度的增大。但由於CCD本身無法將模擬信號直接轉換為數字信號,因此還需要一個 專門的模數轉換芯片進行處理,最終以二進制數字圖像矩陣的形式輸出給專門的中央控制器處理芯片。而CMOS傳感器中每一個感光元件都直接整合了放大器和模 數轉換邏輯(ADC),當感光二極管接受光照、產生模擬的電信號之後,電信號首先被該感光元件中的放大器放大,然後直接轉換成對應的數字信號。

CCD與CMOS工作示意圖

CMOS和CCD圖像傳感器的主要區別就是CMOS本身就有ADC,而CCD只能使用外部的ADC。CMOS圖像傳感器集成的ADC能夠直接將模擬的電壓信號直接 轉換成二進制的數字信號。這些數字信號將被進一步處理後最終根據不同的色度要求形成紅、綠、藍三種色彩信道,通過相應的像素來顯示出具體的顏色和深度。除此之外,還有一主要區別在於讀出信號所用的方法。CCD的感光元件除了感光二極管之外,還包括一個用於控制相鄰電荷的存儲單元,CCD感光元件中的有效感 光面積較大,在同等條件下可接收到較強的光信號,對應的輸出電信號也更明晰。而CMOS感光元件的構成就比較覆雜,除處於核心地位的感光二極管之外,它還 包括放大器與模數轉換電路,每個像點的構成為一個感光二極管和三顆晶體管,而感光二極管占據的面積只是整個元件的一小部分,造成CMOS傳感器的開口率遠 低於CCD(開口率:有效感光區域與整個感光元件的面積比值);這樣在接受同等光照及元件大小相同的情況下,CMOS感光元件所能捕捉到的光信號就明顯小 於CCD元件,靈敏度較低;體現在輸出結果上,就是CMOS傳感器捕捉到的圖像內容不如CCD傳感器來得豐富,噪點較明顯,這也是早期CMOS傳感器只能 用於低端場合的一大原因。CMOS開口率低造成的另一個麻煩在於,它的像素點密度無法做到媲美CCD的地步,因此在傳感器尺寸相同的前提下,CCD的像素 規模總是高於同時期的CMOS傳感器。

但隨著科技的日漸進步,CMOS的制作工藝有了大幅度的提高,已經取代了CCD成為了現今數碼相機的主流感光元件。一個生動的畫面通過上述覆雜的機內處理,變成了一系列二進制的數字信號,感光元件的任務就此結束。下面要開始忙活的,就是相機的大腦——處理器了。

Colorful Days——處理器篇

數碼相機中處理器主要分兩類,中央處理器和圖像處理 器。前者是數碼相機的大腦,數碼相機的一切動作,例如開機自檢、錯誤處理等,都由中央控制器發出。中央控制器是一塊可編程的DSP(Digital Signal Processing 數字信號處理),在外圍或其內部,有一個小容量的FLASH,負責存放一些程序語句。中央控制器按照這些程序語句對相機的各種操作做出反應,例如對環境的 光線強度做出判斷、調節感光二極管放大器的放大率、用不用閃光燈、采用何種快門速度和光圈等。

另外的圖像處理器中除了要把每一個像素點的顏色計算出來外,還要把它們按照一定的時鐘周期進行排列,組成完整的圖像。在某些場合還要對圖像進行一定格式的壓 縮,使圖像的容量更小。圖象處理器實質上也是一塊可編程的DSP處理器。事實上,圖像處理器算法的好壞對處理出來的圖像質量影響很大。

在感光元件將實際景物轉換為一系列二進制的數字信號後,ADC就會將數字信息流傳遞給數字信號處理器DSP。在DSP中,大量的數字信息經一系列預設的程序 指令後整合成完整的圖像。這些指令包括繪制圖像傳感器數據、分配每個像素的顏色和灰度。在單一傳感器數字相機中,如果只有一個彩色濾鏡陣 列,算法程序將主要進行每個像素的顏色數據處理。算法程序通過分解臨近的像素顏色來決定某一特定像素的具體色值。如果使用RGB顏色的話,那麽組成最終圖 像的每個像素的顏色都可以看成是三原色的合成。在對電壓/電流信號進行量化以後,圖象處理器要對像素的顏色進行計算。例如,在R單元得到的數值是255, 在G單元得到的是153,在B單元得到的是51,那麽,圖象處理器按照本身定義的算法,將以上三個值代入,得到一個R值為255、G值為153、B值為 51的顏色。通過如上步驟,最終的圖像才能夠顯示出自然的顏色。

每個廠商設計的處理程序各不相同,他們通過各不相同的色彩平衡與色飽和度設置來生成彩色圖像。數碼相機還運用一個或者多個DSP以及其他設備來共同處理所得 數據,以期達到完美畫質,並且充分考慮消費者對畫質偏好的選擇權利。如果想要拍下本不需要的噪點,或者通過電子快門來實現霧化效果,這些需求制造商都是通 過對算法處理程序進行相應的修正來滿足的。類似的程序修正還有很多,例如圖像銳化的應用,白平衡的預設等等。所以我們可以得出如下的結論,各個制造商所產 數碼相機的最大不同就在於圖像處理過程的種種差異,而這也是導致各廠家影像風格不同的最主要原因。

看到這裏,大家應該知道所謂的“尼康銳、佳能魅”的原因了吧,攝影師在得到艷麗的照片後就就該琢磨怎麽把它保存下來了,而這也就是照片生產過程中的最後一步——存儲工作了。

存在的力量——存儲器篇

存儲器一般是數碼相機的外設部分,因為數碼相機的內部一 般只會安裝很小容量的FLASH芯片,這對拍攝高分辨率的照片來說是遠遠不夠的。一般的外設存儲器有CF(Compact Flash)、SM(Smart Media)、MMC(Multi Media Card)、SDC(Secure Digital Card)、MSD(Memory Stick Duo)、IBM的微型硬盤等。但就一般而言,這些存儲器除了IBM的產品以外,其他的都是采用閃存FLASH來作為存儲部件的。我們就從FLASH的內 部微觀結構來看它是怎麽保存數據的。

FLASH中絕緣柵MOS管的底層是一個晶體管的NP結,在這個NP結的上面有一個被場氧化物所包圍的多晶矽浮空柵。這個浮空柵的“浮空”構成了MOS管的源極、漏極之間的導電溝。如果這個浮空柵上有足夠的電荷存在而不用依賴電源,那麽就可以使MOS管的源極、漏極導通,在斷電的情況下也可以達到保存數據的目的。在 MOS管的源極和柵極之間加一個正向的電壓,使浮空柵上的電荷向源極擴散,那麽源極、漏極不導通;如果在源極和柵極之間加一個正向的電壓U-1,但同時也 在源極和漏極之間加一個正向的電壓U-2,而且U-2總是小於U-1,那麽源極上的電荷就向柵極上擴散,使浮柵帶上電荷,這樣就可以使源極、漏極導通。因 為浮柵是“浮”空的,沒有放電回路,浮柵上的電荷可以在斷電的情況下很長時間不向其他地方擴散,使源極和漏極保持“開/關”。

這樣,控制器通過一定的接口和圖形處理器連接。在接到寫入命令以後,可以就控制某個MOS管的源極和柵極、源極和漏極電源的開或關,使其中的MOS管導通或斷開,從而達到存儲數據的目的。

編者結語:

通過本文,相信很多朋友已經大致了解了數碼相機各部分的基本工作原理,達到了知其然也知其所以然的新境界。數碼相機的平民化也讓更多的人享受到了攝影的樂 趣,科技的不斷創新也在不停地改變著人們的生活。由此可見,科技並不只是高高在上的空中樓閣,也能成為幫助我們留下永恒瞬間的隨身夥伴。

http://tech.sina.com.cn/digi/dc/2014-11-05/08419762278.shtml

數碼相機的成像原理

數碼相機的成像原理圖

http://www.elecfans.com/article/88/131/190/2009/2009042754407.html

數碼相機的成像原理可以簡單的概括為電荷耦合器件(CCD)接收光學鏡頭傳遞來的影像,經 模/數轉換器(A/D)轉換成數字信號後貯於存貯器中。數碼相機的光學鏡頭與傳統相機相同,將影像聚到感光器件上,即(光)電荷耦合器件(CCD) 。C CD替代了傳統相機中的感光膠片的位置,其功能是將光信號轉換成電信號,與電視攝像相同。CCD是半導體器件,是數碼相機的核心,其內含器件的單元數量決定了數碼相機的成 像質量——像素,單元越多,即像素數高,成像質量越好,通常情況下像素的高低代表了數碼相機的檔次和技術指標。CCD將被攝體的光信號轉變為電信號—電子圖像,這是模擬信號,還需進行數字信號的轉換才能為計算機處理創造條件,將由模/數轉換器(A/D)來轉換工作 。數字信號形成後,由微處理器(MPU)對信號進行壓縮並轉化為特定的圖像文件格式儲存; 數碼相機自身的液晶顯示屏(LCD)用來查看所拍攝圖像的好壞,還可以通過軟盤或輸出接口直接傳輸給計算機進行圖像處理、打印、上網等工作。

其工作原理及圖像處理過程如下圖:

數碼相機的成像原理圖

數字相機成像原理分析

對於數字相機,成像過程遠遠比膠片上覆雜。但不管數字成像技術如何發展,成像原理和基本要素還是和膠片成像過程相類似的。數字相機也有鏡頭,但通過鏡頭的光線不再像膠片相機中那樣投射到膠片上,而是直接射在感光器的光敏單元上,這些感光器由半導體元件構成,由數字相機的內置智能控制裝置對入射光線進行分析處理,並自動調整合適的焦距、暴光時間、色度、白平衡等參數,然後將這些數據傳送給模/數轉換器ADC(Analog Digital Converter),ADC最後把這些電子模擬信號轉換成數字信號。

數字相機的內部還具有若幹智能處理器,包括一些特定用途的集成電路(ASIC)和主CPU。按照這些內部處理器預設的運算法則和標準處理程序,所有數據經處理最終生成一個圖像文件,然後存儲在相機內部的電子存儲器中。當這些過程結束後,圖像文件就能夠傳輸到計算機中,經由打印機輸出或者顯示在電視屏幕上。同時圖像文件也能夠在相機內部顯示,通過自帶的LCD顯示屏進行預覽,並利用相機LCD顯示屏的操作菜單進行處理,對於不滿意的圖像可以刪除後重新拍攝。

攝像者能夠通過相機控制面板上的眾多開關、按鈕來進行參數預設,數字相機的智能控制設備則經過如上步驟繁瑣的過程不斷調整操作系統設置,從而精準記錄圖像。這一切繁雜的數據處理的全部過程就發生在你手掌中那個輕靈而精致的相機中。

以上僅僅是對數字相機成像技術的簡要梗概。根據具體細微設計的不同,數字相機也分成了許多種類。後面我們會分別詳細介紹數字相機成像的具體步驟。

圖像傳感器

到目前為止,人們對數字相機性能的關註大部分集中在所攝圖片的像素高低上。像素的高低直接取決於數字相機圖像傳感器的尺寸和密度。圖像傳感器是數字相機的核心結構,主要分為CCD (Charge-Coupled Device)光電荷耦合器件和CMOS (Complementary Metal Oxide Semiconductor) 互補金屬氧化物半導體集成電路兩種。圖像傳感器由具有光傳感單元和光敏二極管列陣矽芯片制成。這些光傳感單元與像素高低直接相關,它們能夠與撞擊到上面的光脈沖相作用,並將其轉換成電荷信號。

圖像傳感器上的光敏單元數目(像素)有兩種表示方法。一是用X/Y軸方向(即傳感器的寬度和高度方向)數目乘積表示,如640×480;另一種是用光敏單元總數來表示,如一百萬像素。

制造商通常對於給定的圖像傳感器會給出兩個像素數目指標。第一個數字是傳感器上所有的像素數目,如三百三十四萬像素或者寫為3.34 Mega Pixels。第二個數字是傳感器上真正用於捕捉圖像的光敏單元(激活像素)數目。第二個數字一般比第一個小5%左右。

在超凈環境中生產數字相機

造成這5%差別的原因有很多。在目前的傳感器制作工藝中,生產一個100%完美毫無缺陷的產品幾乎是不可能的,我們通常把圖像傳感器生產過程中出現的有缺陷光敏單元稱為暗像素或者缺陷像素。還有部分像素被用於其它方面,例如用於從傳感器讀取數據時的校準過程,或者為了保證圖像比例而故意不使用。很小的一部分處在傳感器邊緣區域的像素被人為遮蔽,避免接受外來光線,而是用於檢測CCD背景所產生的噪聲,以便在實際圖像數據中將背景噪聲加以扣除。

需要技術的像素數與CCD尺寸關系不是線性的,從三百萬像素提高到四百萬像素像素數增加了一百萬,但CCD尺寸並不會增加25%,甚至有可能沒什麽變化。

目前大多數的數字相機都只使用一個單圖像傳感器(CCD或者CMOS),只有少數專業級數字相機使用多個圖像傳感器——入射光被光學棱鏡分成相等的部分後再被多個圖像傳感器接收。使用多個圖像傳感器可以減少不同顏色之間的幹擾,並且消除圖像邊緣的偏色問題。這些多圖像傳感器的數字相機由於結構覆雜,制作工藝要求高,所以體積比較大,而且價格昂貴。

有趣的是,多圖像傳感器的設備也無線性變化規律可循。在多數情況下,它們必須有三個獨立的圖像傳感器(CCD或者CMOS)分別對應紅、綠、藍三種顏色的處理工作,每一個傳感器承擔每個像素1/3的信息處理量。在一個3百萬像素的三傳感器的攝像機中,每一個傳感器都必需是三百萬像素的,但是用於靜態拍攝的多傳感器數字相機中就不存在這個問題。它們內部多傳感器對信息的處理方式隨著制造商、相機類型的不同而迥異。

一些三傳感器數字相機采用圖像插值運算技術,它們的三個傳感器就是各負擔最終畫面1/3的信息處理。其他的多傳感器數字相機則先將每個傳感器初始入射光信息混合後,再用覆雜的算法程序進行處理合成。例如現在已經停止生產的Minolta RD-175 數字相機,它具有三個CCD傳感器,其中兩個對應於綠色的處理,第三個傳感器則兼顧紅藍兩色。(這種兩個傳感器對應於綠色的處理方式與單傳感器中Bayer彩色濾色陣列的工作原理類似,下面將詳述)。在RD-175中,每個傳感器都不到五十萬像素,但是它們通過算法程序處理後的畫質相當於一百七十萬像素左右。

在許多數字相機中,傳感器的每個像素只有一部分位置是感光性的,而且只能感受某一特定方向入射的光線。因此,如何盡可能的使光線直接投射到像素感光區域就顯得非常重要。為達到這一目的,許多商品化的數字相機圖像傳感器中,每個像素前都有一個“微透鏡”用來保證光子直接入射到像素的感光區域。

因為圖像傳感器本身只能完成光電轉換而無法分辨顏色,數字相機通常采用彩色濾鏡陣列CFA(color filter array )來實現彩色輸出。CFA的主要作用是讓每個像素只感受單一顏色的光線,最終重新組合出彩色的圖像。制造商根據不同的色彩需求來選擇不同的CFA結構,不管何種CFA結構其目的都是使所需光線通過濾鏡,使每個像素接受的光線具有單一波長。所有CFA的設計都盡量減少入射光線在相鄰像素之間的幹擾,努力使景物色彩準確顯示。

CFA讓每一個像素只感受一種顏色的光線

CFA結構中最流行的是被稱為Bayer模式的彩色濾鏡列陣。主要特征為在像素前面以間隔的方式放置紅、綠、藍色的濾鏡,而且綠色濾鏡的數量為紅色(或藍色)的兩倍。這樣做是因為人眼對綠色光波比紅藍兩色要敏感的多,所以這樣的數量分配就使得人眼所見的圖像亮度適宜,更接近真實色彩。

究竟什麽是真正的不失真的優質畫色呢?由於從科學的角度上來定義並科學測定人眼對色彩的感知是一個極其覆雜的課題,所以產生了許許多多的標準,莫衷一是。不同的制造商則選擇采用不同的模式和運算程序來定義它們認為的數字相機的最佳色彩。

所有的數字相機在圖像傳感器上都裝有一個電子快門(和傳統膠片相機的機械快門不同),電子快門的作用是精確調節入射光線投射到傳感器的時間。電子快門的開關控制傳感器是否接收外來光線。有些高級數字相機甚至還加入一個昂貴的機械快門,這並不是畫蛇添足,在電子快門關閉完成後,它能夠有效地防止可能產生的極少量光線入射在傳感器上的現象。這就大大降低了合成圖像上產生陰影、條紋和模糊的可能。

當你面對要拍攝的景物按下一半快門的時候,數字相機會鎖定焦點和曝光值——這個步驟和傳統膠片相機是一樣的。但當你按下全部快門後,發生的事情就和膠片相機完全兩樣了。

1. 第一個步驟是機械快門關閉(如有機械快門的話),同時傳感器立即進行電荷清洗。這樣做的原因是因為圖像傳感器一直充盈著電荷而保持於激活狀態(在一些高級的數字相機中,圖像傳感器能夠在捕捉圖像前處於休眠狀態,這樣有助於散熱和改善信噪比)。在沒有接到指令前,圖像傳感器一直以大約1/60秒的速度為周期進行電荷更替,所以,在準備捕捉圖像前的瞬間,所有的剩余電荷必須被清洗幹凈。

有趣的是,一些數字相機(例如Olympus Camedia E-100RS)能夠將最近的清洗數據存入緩存,這樣你就能拍下在真正按下快門前的景象了。眾所周知,小孩和一些寵物在照相機前會不安分地動來動去,在這類拍攝情況下這樣的功能是有意義的。

2. 當在攝影者選擇將照相機拍攝前的電荷分布數據存入緩存或清除後,數字相機的所有程序處理器開始正式工作。其中一個處理器是將存入緩存的數據進行調整和設置,為拍攝做好準備。例如,控制白平衡的處理器開始設置在當前圖像條件下具體那些像素為白色,並且會調整所有色相中不為白的像素。其他比如焦距、閃光和其他參數的預設過程也與此相近。這些參數也會被存入緩存,以備後用。如果在拍攝過程中LCD顯示器也在工作的話,這些數據也將被顯示出來。

3. 當以上兩個步驟完成後,拍攝前的圖像傳感器設置就告結束,一切就緒後當你按動按鈕時,相機的機械快門打開並同時激活電子快門,在預設的曝光時間內接受光線,曝光結束後,機械快門也自動同時關閉。

4. 在數據處理過程中電子快門會再次打開,直到攝像者按動按鈕開始為下一張相片的拍攝進行數據清洗為止。當處理器(攝影者)啟動電子閃光設置後,數字相機會自動照射所攝景物,一個單獨的光線感應器會檢測閃光強度,檢測結果達到曝光要求後閃光燈就自動關閉。

由於圖像傳感器的電荷清洗過程和拍攝參數設置過程都需要一定的時間,在攝像者按下快門後到圖像拍攝完畢之間就不可避免的產生了延時效應。在市面上的普通數字相機,其延時從60毫秒到1.5毫秒不等。

應用大容量的緩存設備和高速處理器能夠縮短延時效應。這就是為什麽能夠進行高速拍攝的數字相機昂貴的原因。在這些價格不菲的專業數字相機中,Nikon DH1具有128MB緩存。其他一些相機,例如Kodak誷 DCS 520, 620, 和 Fuji S1具有64MB緩存。少數數字相機具有16MB或者32MB緩存。一些帶有智能多功能芯片的圖像傳感器(多數為CMOS)的數字相機的數據傳遞速率通常比較高,這是因為和所有的數字處理系統相類似,處理器內部的帶寬和處理能力決定了數據的處理速度。

圖像傳感器通過將入射的光子轉換成電子形成模擬信號,下一個步驟就是未被光敏單元束縛的電荷開始定向移動,通過輸出放大器形成電壓信號,這些電壓信號繼續傳遞至模數轉換器ADC

。

CMOS和CCD圖像傳感器的主要區別就是CMOS本身就有ADC,而CCD只能使用外部的ADC。CMOS圖像傳感器的缺點是有噪聲的影響,但是其最大的優勢是集成有ADC。ADC能夠直接將模擬的電壓信號直接轉換成二進制的數字信號。這些數字信號將被進一步處理後最終根據不同的色度要求形成紅、綠、藍三種色彩信道,通過相應的像素來顯示出具體的顏色和深度。

ADC將數字信息流傳遞給數字信號處理器DSP(Digital Signal Processor)——處理器的構造每種數字相機各不相同。在DSP中,大量的數字信息經一系列預設的程序指令後整合成完整的圖像。這些指令包括繪制圖像傳感器數據、分配每個像素的顏色和灰度。在單一傳感器數字相機中,如果只有一個彩色濾鏡陣列,算法程序將主要進行每個像素的顏色數據處理。算法程序通過分解臨近的像素顏色來決定某一特定像素的具體色值。如果使用RGB顏色的話,那麽組成最終圖像的每個像素的顏色都可以看成是三原色的合成。通過如上步驟,最終的圖稀奧厶逞轄釗耍胱⒁餑愕撓鎇裕 蓖能夠顯示出自然的顏色。

大多數數字相機能夠記錄下圖像傳感器所傳遞的全部圖像數據,在此基礎上,DSP就成為圖像分辨率的控制因素。例如,用一個3M像素數字相機以VGA模式進行拍攝,而不是僅僅限定為640×480分辨率,相機將得到全部的20486×1548色彩位度。接著,通過攝像者在拍攝前在LCD面板上進行的設置,DSP就會按照設定的分辨率生成圖像。

每個廠商設計的處理程序各不相同,他們通過各不相同的色彩平衡與色飽和度設置來生成彩色圖像。數字相機還運用一個或者多個DSP以及其他設備來共同處理所得數據,以期達到完美畫質。並且充分考慮消費者對畫質偏好的選擇權利。如果想要攝下本不需要的噪聲,或者通過電子快門來實現霧化效果,這些需求制造商都是通過對算法處理程序進行相應的修正來滿足的。類似的程序修正還有很多,例如圖像銳化的應用,白平衡的預設等等。所以我們可以得出如下的結論,各個制造商所產數字相機的最大不同就在於圖像處理過程的種種差異。

冷暖色調對最終照片的

風格影響明顯

經過DSP處理生成的圖像數據由另一個程序處理器轉化為圖像文件——通常為JPEG、TIFF格式或者RAW原始存儲格式。和拍攝時間、拍攝預設條件相關的數據(快門速度、白平衡、暴光補償、閃光設定、時間日期設定等等)通常一並附在該文件上。如果該文件不是RAW或者TIFF格式而且相機的功能允許的話,它還能夠按照拍攝者的意願進行不同程度(通常為高、中、低三種)的壓縮。文件壓縮的算法程序要在最大畫質保證的前提下充分考慮到文件大小和處理速度之間的關系。最後,文件被存儲在相機的存儲器中。

當圖像被存儲到存儲器的同時,這些圖像也會在LCD顯示器或電子取景器上同時顯示出來。我們一般建議大家選擇光學取景器來觀察拍攝目標,而用LCD顯示屏來設置拍攝參數和觀察拍攝到的照片。由於數字相機的LCD顯示技術只是相對粗略顯示圖像,而不能顯示出和所記錄的真實畫面同樣分辨率,所以即使是高分辨率的LCD顯示屏也很難用於精細的對焦和取景,而且LCD顯示非常費電。另一個明顯的缺點是由於接近CCD或者CMOS圖像傳感器而產生的噪聲,LCD工作時發出的熱量和其他幹擾因素會在最終的畫面上顯示出瑕疵。

大多數數字相機經常采用三種可視取景器:玻璃結構、分光結構、移動反光鏡結構

。分光結構的取景器能夠讓90%的光線通過一個透鏡到達傳感器,10%的光線被扭轉90度方向後通過五棱鏡進入觀察者的眼中。這種取景器的優點是透鏡不會移動,減少了振動損耗並且相互連接緊密。但是它的致命缺點是不適於室內和暗光條件拍攝,因為這時已經無法對景物進行取景和聚焦了。

大多數單鏡頭的膠片相機和專業數字相機都采用移動反光鏡結構的取景器。這種結構能夠使100%的光線進入拍攝者的眼中。當你按下快門,反光鏡立即擺離原來的位置,暫時遮蔽取景器同時將100%的光線傳遞到膠片或者圖象傳感器。當反光鏡擺回原來的位置後,拍攝者就能夠繼續觀察所攝景物。如果這種擺動速度足夠快,反光鏡遮蔽取景器的時間就不是個大問題。

光學玻璃的取景器相對而言結構比較簡單,價格也不貴,所以廣泛被家用型數字相機采用。它由透明玻璃制成,觀測範圍大於鏡頭的視角。它的主要優點是無需動力,也沒有可移動的部分,而且比移動反光鏡結構要亮一些。然而,它的缺點是不夠精準(它所顯示的部分比實際鏡頭捕捉的畫面小,所以拍攝者經常會在最後的拍攝圖像的邊緣中發現不必要的部分),容易產生視差。

視差產生的主要原因是由於拍攝者眼睛是位於鏡頭旁邊一兩英寸的位置,和鏡頭本身的視角有微小的差異。這種差異對於拍攝遠景沒有什麽影響,但當你拍攝近景的時候,這種偏差就變得明顯起來。在微距攝影時這種偏差就大到使取景器完全失去作用了。

電子取景器是繼光學取景器之後的一種新技術。它的主要結構是一個體積微小,耗能低,分辨率高的彩色顯示器。除了能夠精確顯示構圖之外,大多數電子取景器還能顯示出拍攝者預設的主要參數,例如焦距、光圈、閃光等等。電子取景器現在普遍用在可攜式攝像機中。在數字相機中電子取景器作為一種比較新和相對不成熟的技術往往有顯示效果不如光學取景器明亮和清晰的缺點。

在上述的連鎖處理過程中,相當一部分是幾乎同時發生在數字相機內部的。這些工作主要由一個主CPU全面控制,由許多處理器和特定功能集成電路來具體檢測和完成這些繁瑣的功能。例如,操作系統必須時刻對拍攝者預設的參數進行監控,使它們在指定的時間得以運用;電池消耗狀況必須時刻被顯示,以便使拍攝者能夠及時知道是否有足夠的電量完成整個圖像的拍攝,從而避免工作過程被打斷;器件監測能夠及時顯示各部分器件是否工作正常等等。

對於不同品牌和類型的數字相機而言,DSP和ASIC芯片各不相同的。目前的設計潮流是將盡可能多的功能集中在盡可能少的芯片上,借此來降低成本和節約相機空間。

所有這些處理過程都需要大量的電能。幾年前,當你要使用數字相機的時候,你需要準備許多堿性電池。這是因為當時的數字相機耗電極快,往往你所需的一組照片還沒有拍攝完畢就需要更換電池。這一現象現在已經有所改觀,今天的數字相機一方面電池的儲能有所提高,另一方面耗電也在逐步下降。許多數字相機現在已經不用堿性電池,而改用可充式鎳氫電池或者鋰離子電池。少數制造商(例如Sony)還研發出智能電池,這種電池用在數字相機中能夠精確顯示電能所能維持的剩余時間。

數字相機的發展趨勢是覆雜化、多器件和多功能化。在這種背景下,電能消耗將持續增長,能源技術將成為數字相機發展的一個重要研究領域。

http://www.xmsn.cn/xmsn_Article_8517.html

什麼是LOG 什麼又是RAW? 兩者錄影時的差異與考量為何?

攝錄影設備不斷的推陳出新,想當然耳,在可支撐的預算內,大家都想追求最佳的畫質,不論是RAW拍攝或是Log色彩,都是小攝影師的期待規格,有Log是基本、有RAW是夢想,但你是否搞懂其中的差異?

RAW和LOG其實不該相提並論

雖然標題看似要比較兩者,但其實兩者皆代表了不同的觀念。「選擇RAW還是LOG」對有些人來說好像在選擇「風格檔」一樣,但這兩者如何選擇,跟畫面風格並無太大關係,重點在於後期作業方式以及製作成本考量。

有人說:有RAW的話,LOG就沒有意義了。但這可不一定,要進一步討論,要先知道這兩者分別代表的意義。

一、什麼是RAW

先講RAW好了,RAW是不是一種檔案? 如果僅說「是」,只對了一半。

嚴格說起來,RAW是指檔案數據儲存的「概念」。錄影時所產生的RAW格式,和一般坊間常見的影音格式(如mp4)是大不同的。

而RAW也是一個泛稱,如英文的”raw”,意即:保留了每一顆感光元件所接收到的最原始、未經過影音編碼壓縮的數據資料。

你也可以說RAW是「檔案格式」,但每一家設備的感光元件都不同,所以生成的RAW編碼方式也都不同,最後也都使用了不同的檔案容器,如:R3D、DNG、BRAW…等,以上都是採用了「原始數據保存」的檔案格式,但因為來自不同品牌設備,所以構造都不一樣。所以常聽到的「RAW格式」並非指某種特定格式的檔案。

RAW屬於高成本、高規格製作時所採用的方式,因為保存龐大未壓縮的原始感光數據,勢必耗費極大的空間,存取時的頻寬要求也極高,還需要對應的解碼軟硬體,而RAW的最大優勢,就是把設備傳感器(CMOS,感光元件)對光線的寬容能力,發揮到極限。

二、什麼是Log

再來講一下Log。Log是不是一種檔案? 不是,絕對不是,所以如果有人跟你說「拍Log檔」那應該被糾正。

Log可說是一種「色彩模式」,也可說是「色彩風格」,用學術一點的講法,它僅是以Log曲線定義各級曝光分佈的方式,讓攝影師在使用一般影音格式紀錄時,仍能充份保留CMOS明暗兩極的動態範圍,它跟檔案編碼格式無關,任何影音格式的檔案都可以使用這種色彩模式。

在傳統標準的拍攝中,大多攝影機或相機都會採用如Rec.709的色彩來紀錄畫面,泛稱「標準色」,該色彩的光線和色彩飽和度較接近我們人眼真實感受到的圖像。然而這類標準色,同時對於光線的容納範圍有限,也就是亮部容易過曝失真,暗部容易因曝光不足損失細節,在單一曝光模式下,曝光的動態範圍有限。到了後製調色的時候,自然很難再針對曝光做調整,所以才會衍生出Log這種風格代替拍攝時的標準色彩模式。

因為Log同時要容納最亮和最暗的光度值進來,所以切換到Log色彩模式、在未套用任何校色器的狀態下,你會覺得畫面很灰,白沒有很白、黑也沒有很黑,如果監視器沒有校色功能,取景時會有點吃力。

在相機上如果要使用Log的方式紀錄,通常都會歸類在「色彩風格」的設定下、被當作一般濾鏡安置。實際設定方式,翻一下相機的說明書找會比較準確。

Log比起標準模式更優嗎?

以後期調整曝光的彈性來講是的。

但我從來不推薦新手使用Log色彩拍攝,原因一是「後期沒有能力」,畢竟Log在光線的處理上,如果沒有相關知識或經驗、對於色彩的敏銳度又欠訓練的話,後期調整的結果多半不理想,可能會很詭異或是噪訊破表…。原因二是「後期有沒有需要」,一些網路小品要求並不高,那就沒必要拍Log。(這裡指的「要求度」不是畫質,而是指對畫面光線控制的嚴格度。) (請參閱: 給初學者的簡易LOG調色教程 )

除了以上兩個原因,還有一個連許多專業人士都會忽略的考量,那就是「中間曝光的細節丟失」。試想:以Log色彩拍攝的影片,跟使用Rec.709色彩拍攝的影片,所產生的檔案大小都一樣,Log憑什麼動態範圍較大? Log當然是有失才有得,為了容納更多高低光邊緣的曝光值,中間不少光度的區段被捨棄掉了,雖然人眼對於這些中間的光度區段被抽掉感覺差異不大,但如果不巧你要對於一些中間曝光的影像進行較強度的調色處理,還是會有負面影響的。這也就是為什麼在低對比的場景中,我會避免用Log拍攝,因為不想讓Log曲線再去壓縮本來就沒什麼對比的曝光。

當然,隨著10-bit的色彩模式逐漸普及,搭配Log拍攝時,除了能容納更大動態範圍,對於中間區段的光度丟失情況也能有所補強,不過就像前面說的:「有得必也有失」,天下沒有白吃的午餐,10-bit紀錄的檔案相對8-bit大了許多,畢竟前者的光度達1024階,後者僅有256階。

比起Log,RAW擁有更大的動態範圍嗎?

有些人問我說:「覺得Log的動態範圍好像不夠,想換成RAW拍拍看。」

但實際上,Log在動態範圍的表現比起RAW並不會差太多。將這兩者「放在一起比較動態範圍」其實是沒有意義的,因為Log在數位攝影機/相機上的出現,目的就是為了藉由壓縮光度曲線,讓你能在使用一般影音格式的狀況下仍能發揮傳感器的最大動態範圍,講淺白一點:Log同時幫你把最亮和最暗的細節都壓進來了,所以你去比較那個極限沒有意義。

當然啦,RAW類型的素材已是最高標、最原始的數據,論動態範圍,比起Log只會有過之而無不及,但若真要說RAW比起Log的關鍵優勢,應該是在於每一畫格、每一個像素的資訊完整度以及12-bit以上的色彩深度,而非動態範圍。

Log噪訊很嚴重,RAW就不會嗎?

有些人覺得Log的雜訊很嚴重,所以想要用RAW,但這個理由事實上並不成立。

對於「Log噪訊很多」的原因,是來自於:部份Log曲線,會針對暗部曝光進行拉擡,如果暗部的曝光越不足,解像就越吃力,最終造成噪訊叢生的現象。

如果你是拍攝RAW,進到了後期,手動針對暗部進行拉擡,理論上雖然「未壓縮的資訊」會比Log的狀況好一些些,但也不會好到哪裡去。當然,這和你用什麼程式進行解RAW也會有關係。

所以別再怪Log噪訊多了,一個是錄Log時直接幫你把暗部曝光做拉擡,一個是錄RAW到後期再手動拉擡暗部曝光,以結果論而言,兩者相去不遠。換言之,不論是RAW或是Log,在後期調色時皆應適時將暗部的曝光進行壓制。(請參閱: SONY單眼相機錄影之「SLOG罩門」 以及 Crush the Blacks,真正的黑,就該最黑 )

所以,真正能影響噪訊程度的,並非RAW格式或是Log曲線,關鍵在於光線與CMOS的性能。糾結哪種格式的噪訊比較少,不如加強一下前期拍攝時的佈燈吧。

拍攝RAW,不代表曝光不重要

RAW雖然幾乎完全擁有最大動態範圍,但拍攝當下對於曝光仍要有精準的設定,才能確保各級曝光的畫面更完美匹配。如果你連使用一般mp4拍攝標準色彩都沒辦法好好控制曝光,那可就玷汙了RAW的神聖。

同時也要註意:一些雙原生ISO的機子,在採用不同原生ISO的狀態下,動態範圍的分佈區域也會有差異,這是後期無法再改變的。(請參閱 有效掌握「雙原生 ISO」,提升動態範圍 )

https://jacksonlin.net/20200831-raw-log-comparison

CMOS Image Sensor原理简述

简介

CMOS称为互补式金属氧化物半导体(Complementary Metal-Oxide-Semiconductor,缩写作 CMOS),是一种集成电路的设计工艺,可以在硅质晶圆模板上制出NMOS(n-type MOSFET)和PMOS(p-type MOSFET)的基本元件,由于NMOS与PMOS在物理特性上为互补性,因此被称为CMOS(Complementary 的来历)。此一般的工艺上,可用来制作电脑电器的静态随机存取内存、微控制器、微处理器与其他数字逻辑电路系统、以及除此之外比较特别的技术特性,使它可以用于光学仪器上,例如互补式金氧半图像传感装置在一些高级数码相机中变得很常见。

传感器可以通过几种方式进行分类,例如其结构类型(CCD或CMOS),色度类型(彩色或单色)或快门类型(全局或滚动快门)。还可以通过分辨率,帧速率,像素大小和传感器格式对它们进行分类。理解这些术语可以帮助人们更好地了解哪种传感器最适合其应用。无论如何分,图像传感器的目的是相同的 —— 将入射光(光子)转换为可以查看,分析或存储的电信号。 图像传感器是固态设备,并且是机器视觉相机中最重要的组件之一。每年,随着传感器尺寸,分辨率,速度和光敏度的改进,制造出新的传感器品种。

本文分为通识和深入部分。只想初步了解的请看通识(图像传感器技术的一些基础知识,以及它们与它们的分类之间的关系),较感兴趣的请看深入部分。

通识内容

组成部分

以下是典型的CMOS图像传感器。传感器芯片与保护玻璃包装在一起。Package是一个将传感器连接到PCB的平台垫(pads),不同的传感器采用不同的包装(Package)。

固态图像传感器芯片包含由光敏元件,微透镜和微电子元件组成的像素。芯片由半导体公司制造,并从晶圆上切割下来。引线键(Wire bonds)合将信号从芯片转移到传感器背面的接触垫。 该包装(Package)可保护传感器芯片和焊线免受物理和环境损害,提供散热功能,并包括用于信号传输的互连电子设备。 包装前部的透明窗口称为盖玻片(Cover Glass),可保护传感器芯片和电线,同时允许光线到达感光区域。

相机内部的传感器功能

在照相机系统中,图像传感器接收通过透镜或其他光学器件聚焦的入射光(光子photons)。 根据传感器是CCD还是CMOS,它会将信息作为电压或数字信号传输到下一级。CMOS传感器使用片上模数转换器(Analog to Digital Converter,ADC)将光子转换为电子,然后转换为电压,最后转换为数字值。

根据相机制造商的不同,所使用的总体布局和组件也会有所不同。这种布局的主要目的是将光转换成数字信号,然后可以对其进行分析以触发将来的动作。 消费级相机将具有图像存储(存储卡),查看(嵌入式LCD)以及机器视觉相机没有的控制旋钮和开关的其他组件。

CCD与CMOS的不同

CCD传感器(Charged Couple Device,电荷耦合器件)同时开始和停止所有像素的曝光。 这称为全局快门。 CCD然后将该曝光电荷转移到水平移位寄存器,然后将其发送到浮动扩散放大器。注意:2015年,索尼宣布了计划在2026年之前停止生产CCD并终止对CCD的支持。CCD的特点有:1. 全局快门,2. 低噪声,3. 高动态范围, 4. 中等帧率,5. Subject to smearing

过去,CMOS传感器一次只能启动和停止一行像素的曝光,这被称为卷帘快门。随着时间的推移,这种情况发生了变化,现在市场上有许多全局快门CMOS传感器可用。CMOS传感器为每个像素 列使用较小的ADC(下图红框),从而提供比CCD高的帧速率。多年来,CMOS传感器经历了重大改进,使大多数现代CMOS传感器在图像质量,图像速度和总体价值方面均与CCD相同或更高。CCD的特点有:1. 全局快门和卷帘快门,2. 非常低的噪音,3. 很高的动态范围,4. 很高的帧频,5. No smearing

单色和彩色传感器

对于右上方所示的颜色传感器示例,所使用的滤色器阵列是拜耳滤色器。此滤镜模式使用50%的绿色,25%的红色和25%的蓝色阵列。虽然大多数彩色相机使用拜耳滤镜图案,但还有其他滤镜图案可用,它们具有不同的图案排列和RGB拆分方式。

图像传感器尺寸

图像传感器具有不同的格式类型(也称为光学类别,传感器尺寸或类型)和封装形式。分辨率和像素大小将决定传感器的整体大小,较大的传感器比较小的传感器具有更高的分辨率或更大的像素大小。了解传感器格式对于选择照相机的镜头和光学元件很重要。所有镜头均针对特定的传感器格式和分辨率而设计。请注意,传感器格式仅描述传感器芯片的区域,而不描述整个传感器。

以下是CMOS传感器的示例,其类型为2/3英寸。 但是,模具的实际对角线尺寸仅为0.43英寸(11毫米)。 当前的传感器“英寸”类型不是传感器的实际对角线尺寸。传感器格式类型似乎有些模棱两可,但实际上是基于旧的视频摄象机管,英寸测量是指视频管的外径。下图显示了最常见的传感器格式类型及其实际传感器对角线尺寸(毫米)的图表。

像素大小

像素大小以微米(µm)为单位,并且包括光电二极管和周围电子设备的整个面积。 CMOS像素由光电二极管(photodiode),放大器(amplifier),复位门(reset gate),传输门(transfer gate)和浮动扩散组成(floating diffusion)。然而,这些元素可能并不总是在每个像素内,因为它们也可以在像素之间共享。 下图显示了CMOS单色和彩色像素的简化布局。

通常,较大的像素尺寸对于提高光敏感度更好,因为光电二极管有更大的面积来接收光。如果传感器格式保持不变,但分辨率提高,则像素尺寸必须减小。尽管这可能会降低传感器的灵敏度,但像素结构,降噪技术和图像处理方面的改进已帮助缓解了这种情况。为了更准确地了解传感器的灵敏度,最好参考传感器的spectral response光谱响应(quantum efficiency,量子效率)以及其他传感器性能结果。

单色和彩色光谱响应

由于单色传感器和彩色传感器之间的物理差异,以及传感器制造商的技术和像素结构之间的差异,因此不同的传感器将在不同程度上感应光。一种更准确地了解传感器对光的敏感性的方法是读取其光谱响应图(也称为量子效率图)。

下面的2个图表是同一传感器型号的单色和彩色版本。左侧显示单色传感器的光谱响应,右侧显示颜色传感器。 X轴是波长(nm),Y轴是量子效率(%)。大多数机器视觉彩色摄像机都安装了红外截止滤光片,以阻挡近红外波长。这样可以消除图像中的IR噪声和颜色交叉现象,与人眼对颜色的解释方式最匹配。但是,在许多应用中,不使用IR截止滤镜对图像进行成像可能是有益的。无论是否安装了红外截止滤镜,色彩传感器都不会像单色传感器那样灵敏。

量子效率越高,传感器对光的感知越好。

全局与滚动快门

传感器的重要功能是其快门类型。电子快门的两种主要类型是全局快门和滚动快门。这些快门类型在其操作和最终成像结果上是不同的,尤其是在照相机或目标处于运动状态时。下图显示了全局快门传感器的曝光时间。 所有像素都同时开始和结束曝光,但读出仍然逐行进行。该定时产生没有失真或扭曲的图像。全局快门传感器对于高速移动物体成像至关重要。

下图显示了卷帘快门传感器的曝光时间。曝光时间逐行不同,重置和读出发生在不同的时间。 如果目标或相机运动,则此逐行曝光会产生图像失真。 卷帘传感器为成像静态或缓慢移动的物体提供出色的灵敏度。

深入内容

结构

像素结构

像素基础电路结构

CMOS图像传感器中的像素可以看作是由一个光电二极管、光电二极管复位开关、信号放大器和输出电路组成的电路。具有信号放大功能的像素被称为有源像素。MRS为光电二极管的复位晶体管、MSEL为位线选择晶体管、MRD和偏执电流负载形成一个源极跟随器、Vpix为光电二极管的电压、VPIXOUT为输出节点、CSH为采样保持电容、CPIX为像素内的存储节点的电容。源极跟随器是一种电压缓冲器,具有电流放大能力,但不进行电压放大。光生电荷由式AV*(CSH/CPIX)得出。其中AV是源极跟随器的电压增益(<1)。

X-Y像素寻址方式

视频信号是通过行(垂直)和列(水平)扫描器对像素阵列进行光栅扫描获得的。一般情况下,行扫描器在每一帧时间内产生一个行选择脉冲和一个复位脉冲并送入选定行的像素中,列扫描器在每一个行周期扫描各列。CMOS 图像传感器中两种常见的扫描器是移位寄存器和解码器。移位寄存器的优点是结构简单,翻转噪声低,在一些改进结构中读出更加灵活。而解码器具有比移位寄存器更大的扫描灵活性,可以应用窗选读出或跳跃式读出。

固定模式噪声抑制

CCD将光生电荷转移到位于CCD寄存器后端的电荷检测放大器,使得所有信号均通过同样的放大器后读出,因此,放大器的失调保持恒定。另一方面,CMOS 图像传感器中的每个像素的放大器都有失调的波动,这会导致固定模式噪声的产生。MRD 阈值电压的波动是该噪声的主要来源,其大小一般为几十毫伏。因此,CMOS 图像传感器必须增加噪声抑制电路来抑制失调的波动。固定模式噪声抑制的原理如下图。首先,经过一段积分时间后,像素输出一个包含光生信号和放大器失调的信号 VSIG,这个信号读出后被存储在一个存储单元中。像素被复位后输出一个仅包含放大器失调的信号VRST,这个信号再次被读出并存储在另一个存储单元中。通过对两次输出做差,放大器的失调可以抵消。应该指出的是,由暗电流的变化引起的失调不能被抑制。

像素寻址和信号处理结构

卷帘式快门和全局快门

功耗对比

CMOS有缘像素技术

CMOS图像传感器的有源像素由一个光电二极管和一个读出电路构成。下面主要是介绍光电二极管的结构和相应的读出方案。

PN光电二极管像素

PN详细见维基百科。

PN光电二极管像素在早期的CMOS 图像传感器中比较流行。它只需相对简单的修改就可以被整合到 CMOS 制造和设计工艺中,并且这种修改可以通过电路原理图来表述,从而使图像传感器的设计兼容于通用集成电路设计环境中。因此,对于低成本图像传感器或小规模定制化图像传感器来讲,PN光电二极管像素仍然是划算的解决方案。虽然噪声性能通常不如钳位光电二极管像素,但 PN 光电二极管像素在提供更大的满阱容量上具有明显的优势。满阱容量可以通过增加 PN 光电二极管像素的光电二极管电容得到提升,但是钳位光电二极管像素的满阱容量受到光电二极管钳位电势的限制。

PN光电二极管结构

光电二极管复位噪声(kTC噪音)

硬复位和软复位

复位晶体管工作在饱和模式下的复位被称为“软复位“,工作丁线性模式下的复位则被称为“硬复位”。硬复位的噪声电平由上式给出。在软复位模式下的复位噪声被降低到大约 1 / 、,这是复位期间对电流的整流效果造成的。

软复位的一个缺点是它引人了图像拖尾,这是由复位后光电二极管电压对曝光的依赖引起的,即在有限的复位时间内复位电压不足以达到某一固定电压值。在软复位操作前,注人偏置电荷(称为“刷新复位”)可以消除图像拖尾。复位噪声显著影响暂态本底噪声。例如,具有 5fF 电容和 1 V 电压摆幅的光电二极管,软复位的 kTC 噪声电荷和满阱容量分别是 28e- 和 32ke- ,这意味着复位噪声将最大动态范围限制为 61dB。

优秀参考文献

部分需要文明上网

[1] https://en.wikipedia.org/wiki/CMOS

[2] 《数码相机中的图像传感器和信号处理》 CMOS图像传感器

[3] https://thinklucid.com/tech-briefs/understanding-digital-image-sensors/

[4] How does a camera work?

[5] AIA – Camera and Image Sensor Technology Fundamentals – Part One

[6] Part two

编辑于 2022-08-11 18:19

Quan Chen | 悉尼大学 信息技术硕士关注他 | 260 人赞同了该文章

https://zhuanlan.zhihu.com/p/158502818